Dunia kecerdasan buatan (Artificial Intelligence/AI) telah berkembang pesat dalam beberapa tahun terakhir, didorong oleh kemajuan luar biasa dalam Model Bahasa Besar (Large Language Models/LLMs). Namun, di balik kemampuan mereka yang tampak ajaib untuk menghasilkan teks, kode, dan bahkan karya seni yang meyakinkan, terdapat sebuah tantangan teknis yang unik dan sering kali diabaikan. Fenomena ini, yang dikenal sebagai “bottleneck” atau hambatan paling aneh dalam LLM modern, kini menjadi pusat perhatian para peneliti dan pengembang teknologi di seluruh dunia.

Laporan terbaru di bulan Februari 2026 menyoroti bagaimana keterbatasan ini bukan berasal dari kekurangan daya komputasi atau jumlah parameter model, melainkan dari cara model-model ini memproses dan mengingat informasi dalam konteks yang panjang. Memahami hambatan ini sangat krusial bagi masa depan pengembangan AI yang lebih efisien dan andal.

Memahami Masalah ‘Lost in the Middle’

Hambatan paling aneh yang ditemukan dalam penelitian terbaru adalah fenomena di mana LLM cenderung kehilangan informasi yang berada di tengah-tengah input yang panjang. Sebuah studi yang diterbitkan dalam arXiv menunjukkan bahwa meskipun sebuah model memiliki kapasitas untuk memproses puluhan ribu kata sekaligus, kemampuannya untuk menarik kembali atau menggunakan informasi yang ditempatkan secara strategis di bagian tengah teks tersebut menurun secara drastis.

Para ilmuwan menyebut ini sebagai masalah “U-shaped performance curve”. Model bekerja sangat baik dalam mengingat informasi di awal teks (primacy effect) dan di akhir teks (recency effect), namun “melupakan” apa yang ada di antaranya. Hal ini menjadi masalah besar ketika AI digunakan untuk menganalisis dokumen hukum yang panjang, laporan keuangan yang kompleks, atau basis kode perangkat lunak yang masif.

Hambatan Data: Kualitas vs Kuantitas

Selain masalah arsitektur memori, hambatan besar lainnya terletak pada ketersediaan data pelatihan yang berkualitas. Kita sedang mendekati titik di mana data teks berkualitas tinggi yang tersedia di internet publik hampir habis dikonsumsi oleh model-model raksasa. Menurut analisis dari MIT Technology Review, ketergantungan pada data sintetis (data yang dihasilkan oleh AI itu sendiri) mulai menunjukkan risiko “model collapse” atau penurunan kualitas model secara bertahap.

Ketika model AI mulai belajar dari output model AI lainnya, kesalahan kecil dan bias mulai terakumulasi, yang pada akhirnya merusak pemahaman fundamental model tersebut tentang realitas. Inilah sebabnya mengapa data dunia nyata yang otentik dan dikurasi oleh manusia tetap menjadi aset yang paling berharga dan langka dalam industri AI saat ini.

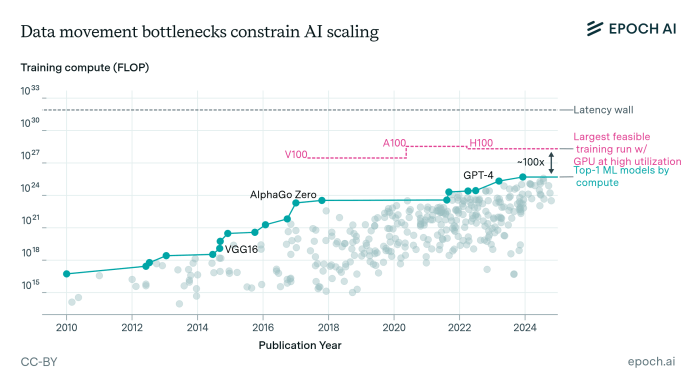

Bottleneck Komputasi dan Efisiensi Energi

Dari sisi infrastruktur, hambatan yang paling nyata adalah konsumsi energi yang masif dan kebutuhan akan perangkat keras khusus seperti GPU tingkat lanjut. Biaya untuk melatih dan menjalankan model-model terbaru telah mencapai tingkat yang hanya bisa dijangkau oleh segelintir perusahaan teknologi raksasa. Hal ini menciptakan kesenjangan digital di mana inovasi AI terkonsentrasi pada pihak-pihak dengan modal besar.

Tantangan efisiensi ini mendorong lahirnya teknik-teknik baru seperti “Parameter-Efficient Fine-Tuning” (PEFT) dan kuantisasi model, yang memungkinkan model canggih berjalan pada perangkat dengan spesifikasi lebih rendah. Upaya untuk menekan jejak karbon dari pusat data AI kini menjadi prioritas utama bagi pemimpin industri yang berkomitmen pada pembangunan berkelanjutan.

Implikasi bagi Pengguna dan Industri

Bagi industri di Indonesia, memahami hambatan-hambatan ini sangat penting untuk menentukan ekspektasi yang realistis terhadap implementasi AI. Perusahaan tidak bisa sekadar memasukkan ribuan dokumen ke dalam AI dan mengharapkan jawaban yang sempurna setiap saat. Strategi pengelolaan pengetahuan yang cerdas dan teknik seperti Retrieval-Augmented Generation (RAG) menjadi solusi praktis untuk mengatasi masalah memori model.

Selain itu, kebutuhan akan spesialis data yang mampu melakukan kurasi data berkualitas tinggi akan terus meningkat. Keahlian manusia dalam memastikan akurasi dan konteks informasi tetap menjadi elemen yang tidak tergantikan, bahkan di era otomatisasi ini.

Menatap Solusi di Masa Depan

Para peneliti tidak tinggal diam. Inovasi dalam arsitektur saraf baru, seperti model berbasis “State Space” atau mekanisme atensi linear, mulai menunjukkan potensi untuk mengatasi hambatan memori tradisional. Visi masa depan adalah menciptakan AI yang tidak hanya pintar secara linguistik, tetapi juga efisien dalam penggunaan sumber daya dan memiliki memori yang presisi layaknya database tradisional.

Dengan terus mendorong batas-batas penelitian sains data, kita perlahan mulai mengurai satu per satu hambatan yang ada. Tahun 2026 kemungkinan akan menjadi saksi lahirnya generasi baru model bahasa yang jauh lebih tangguh dan adaptif terhadap kebutuhan manusia yang semakin kompleks.

Referensi: